こんにちは、おゆひよこ(@oyu_sound)です!

音楽クリエイターやDTMを趣味にしている人の中には「AI、怖ッ!」と感じてる方もいるかもしれません

近年、AI技術は飛躍的に進歩していて、応用範囲もどんどん拡大してますよね

身近な例だと、人工知能チャットボット「ChatGPT」だったり、画像生成AI「Stable Diffsion」だったり・・・

でも、2023年4月現在、まだ音楽制作の領域に目ん玉が飛び出ちゃうほどインパクトのあるAI技術革新は来てません

ただし、今後1~2年以内、つまり「2025年までに音楽制作の世界に革命が幾度となく訪れる」と僕は予想してます

今回は、AIによる音楽制作に焦点をあてて、DTMの未来を探っていきます!

用語解説「DTMとDAWのちがい」

DTM(デスクトップミュージック)=PCを使って音楽制作をすること

DAW(デジタルオーディオワークステーション)=PCで音楽制作をするソフトウェア

まったく新しい形のDAWが登場する?AI中心の音楽制作とは

これからの時代は「DAWとAIが一体化している」というのが当たり前になっていきそうです

AIが制作プロセスを支援する機能があれば、楽曲制作の効率化が図られることは間違いありません

2023年3月30日に公開されたAI音楽生成アプリ「WavTool」は、まさにその先駆けともいえる革命児

これまでにも、音楽制作の分野ではAIを搭載したツールはありました。コード進行やメロディの生成、MIX、マスタリング、合成音声など・・・

でも、WavToolはちがう。なんと「テキストベースでAIに指示を出しながら音楽を作ることが可能になったDAW」なのです!

つまり、自然言語(日常で話すようなコトバ)を用いて曲が作れるようになっちゃったってコト

しかもブラウザベースで動く・・・!

超頭いいAIチャットボット「Conductor」

ちょっと技術的な話をすると、WavToolには「Conductor」と呼ばれるAIチャットボットが搭載されてます

Conductorは音楽理論を含む音楽制作の方法を訓練されていて、対話によってMIDIの生成やプラグインの設定などを自動でやってくれるんですね

基礎となっているのは「GPT-4」っていう、ChatGPTにも搭載されているOpenAIの大規模言語モデル

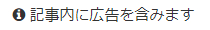

GPT-4がどれぐらい頭がいいのかを大学の試験でシュミレートした結果がコチラ・・・

「GPT-3.5が下から10%の成績だったのに対し、GPT-4は上から10%の成績を収めた」

もはや笑うしかない😇

ジャンルやスタイルの指示はもちろん、ビート生成、メロディの音の長さ・音量の調整などもテキストで指示できます

CubasseやLogic Pro X、Studio Oneなどの既存のDAWにも、WavToolのようなAIチャットボットが搭載されていくことは必然といえます◎

↓1ヶ月もしないうちに予想当たっちゃったね

2023年中にはDAWにAIチャットボットが実装される流れ来そうだな〜!

DTMってDAWソフトの使い方を学ぶだけでもハードル高いから、基本的な設定と操作方法だけでもAIがサポートしてくれたら助かる人たくさんいそう😊— おゆひよこ@深夜の2時間DTM (@oyu_2hdtm) March 6, 2023

AIによってDAWとプラグインが一体化する?

次は「AIによってDAWとプラグインが一体化する可能性」について考えていきます

前述したWavToolにもいえることですが、プラグインはだんだんとDAWに吸収されていくと思われます

ちょっと表現が難しいんですが、音楽制作に必要なプロセスがDAWによって自動化されていくっていうイメージですね

作業をしながらすでにプラグインの処理が済んでいる状態、つまり、いちいちプラグインを設定する必要がなくなってくる、と

近いものとしては、2023年3月27日に発表されたWaves社「StudioVerse」でしょうか

StudioVerseは、プラグインチェイン(複数のプラグインを使った音作り)をDAW上に展開できるAIアシスト

カンタンな話、AIが音声を分析して各トラックのニーズにあった複数のチェインを提案してくれるんですね

「DAWとプラグインの一体化」は、まさにStudioVerseのような機能がDAWに取り込まれてからの話です

要するに「AIがプラグインを超える」ってコト!

すべてのプラグインがAIに代替されるのはまだまだ未来だと思いますが、AIで十分に代用可能なプラグインは確実に増えてくるはずです◎

プラグインが消える?AIを駆使して自作プラグインを作る未来

これまでDTMで使用するプラグインといえば、専門的な知識を持つ企業やプログラマーが開発するものでした

でも、AI技術の発展によってプログラミングのハードルが下がってくると・・・?

ズバリ、その場に応じて必要なプラグインを開発することが個人で可能になります

音声解析からプラグインの自動生成/処理までをAIがやってくれる未来はもうすぐかもしれません

ただし、膨大なデータ量や複雑なシステム構築が必要となるプラグインの開発は個人レベルの環境ではかなり厳しい!

そういった意味では、プラグインを作る企業はこれからも残り続けるでしょう

DTMerに残された唯一のフロンティア、課金への道はこの先もずっと続くのだ・・・

個人でプラグインを開発して販売する人も増えていきそう~

VR空間での音楽制作が現実に!AI技術の革新と可能性

今度は「VR空間内での音楽制作」について考えていきます

VR(バーチャルリアリティ)は、カンタンにいうと「仮想現実空間を作り出す技術」のこと

専用のゴーグルやヘッドセットに映し出された映像や出力された音声によって、まるでその場にいるかのような感覚を得ることができます

すでにVR空間でDTMを行う技術はある程度は形になっていて、代表的なものには「Korg Gadget VR」があります

手持ちのコントローラーを使うことで、仮想世界の中での操作やアクションを可能にしているんですね

これからはAIによってXR(VR=仮想現実、AR=拡張現実、MR=混合現実など)の技術も急速に発展していきます

VR空間内を歩き回りながら、はたまた、現実世界では不可能な方法で音楽制作をしたり、と想像するだけでワクワクしちゃいますね

とはいえ、利便性や没入感といった点ではまだまだ課題が多いのはたしかです

音楽制作においては、鍵盤を叩いたり、キーボードを操作したり、楽器を演奏したりといった感覚はとっても重要!

視覚と聴覚にプラスして「触覚」への感覚を実装できたら、一気にVR空間内でのDTMが一般層にも広がっていくんじゃないかなって思ってます◎

AIが楽器演奏の領域に進出する!?

AIは音楽制作に影響するだけでなく、楽器演奏の領域にも踏み込んでくるといわれています

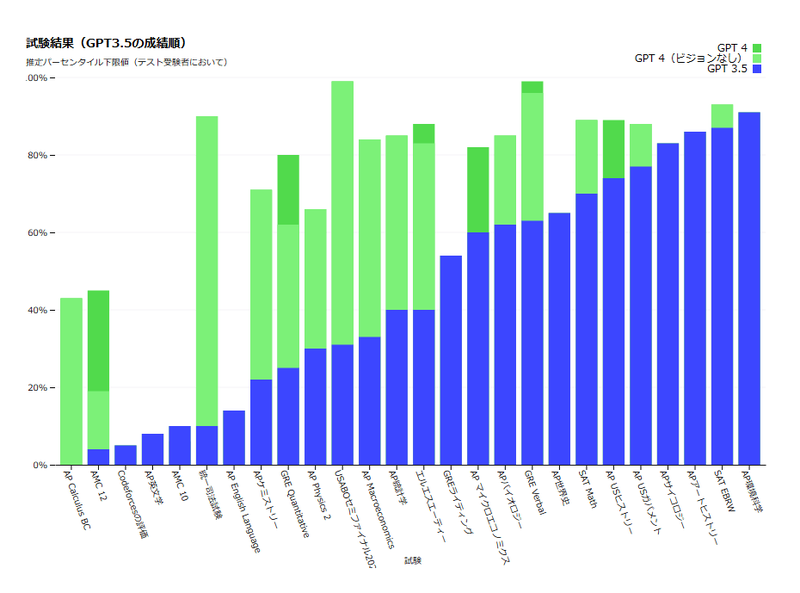

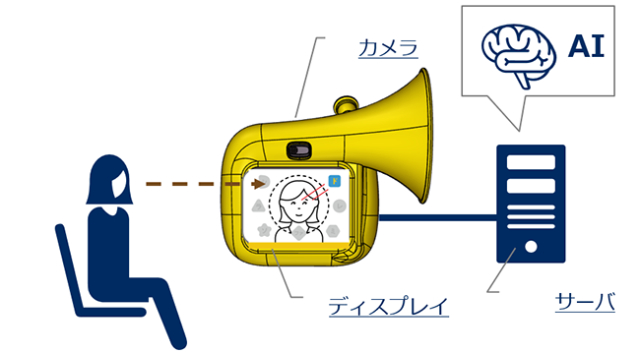

たとえば、NECが開発したAI楽器「ANDCHESTRA」はシンプルな動作でだれでも演奏ができるのが特徴

演奏者の「姿勢」や「目線」によって音階表現を可能にする技術が採用されています◎

音楽に挑戦したいけどハードルが高いと感じてる人、障がいを抱える人、多様な人にとって楽器演奏が身近になるのはステキなことですよね

ただし、音楽制作やアーティストの現場では「AIによる演奏」について批判的な見方もあります

AIによる演奏は現段階ではどうしても「人工的な音」になってしまうので、その課題をどうクリアしていくかが今後のポイントになりそう

演奏者の曲に対する解釈や感情の高ぶりなどの演奏表現をAIに学習させるとなると、それはそれはとてつもない情報量が必要になりますし・・・

「楽器演奏を完全にAIが自動化する未来」はまだ先の話になりそうです

まとめ

今回はDTMとAIとの未来について考えてきましたが、AIは音楽制作を完全に代替するようなものではありません

技術的に見てもまだ人間のほうが優れている分野はたくさんありますし、AIによって生み出される音楽の評価や著作権などの問題も残っています

あと、もっとも重要だと感じるのが「音楽の消費方法がどう変わっていくか?」ですね

仮に10秒でプロクオリティの楽曲が生み出される時代になったら、いったいどうなってしまうのか・・・

AI技術の進歩によって音楽制作や音楽の聴き方が変化していくのは確実

いまのうちから音楽制作とAIの未来について考えておくのも大事なことなのかもしれませんね

「AIと音楽クリエイターの未来!これから必要になってくるスキルとは?」という記事も書いているので、興味があればチェックしてみてください!

-

AIと音楽クリエイターの未来を考える!人工知能が創作活動に与える影響

続きを見る